O Salto Agêntico: 5 Choques da Fronteira da IA em 2026

Em 2026, a IA mudou do chat para a execução "Agêntica" autônoma, operando fluxos profissionais com supervisão humana mínima.

1. Introdução: A Morte da Caixa de Chat

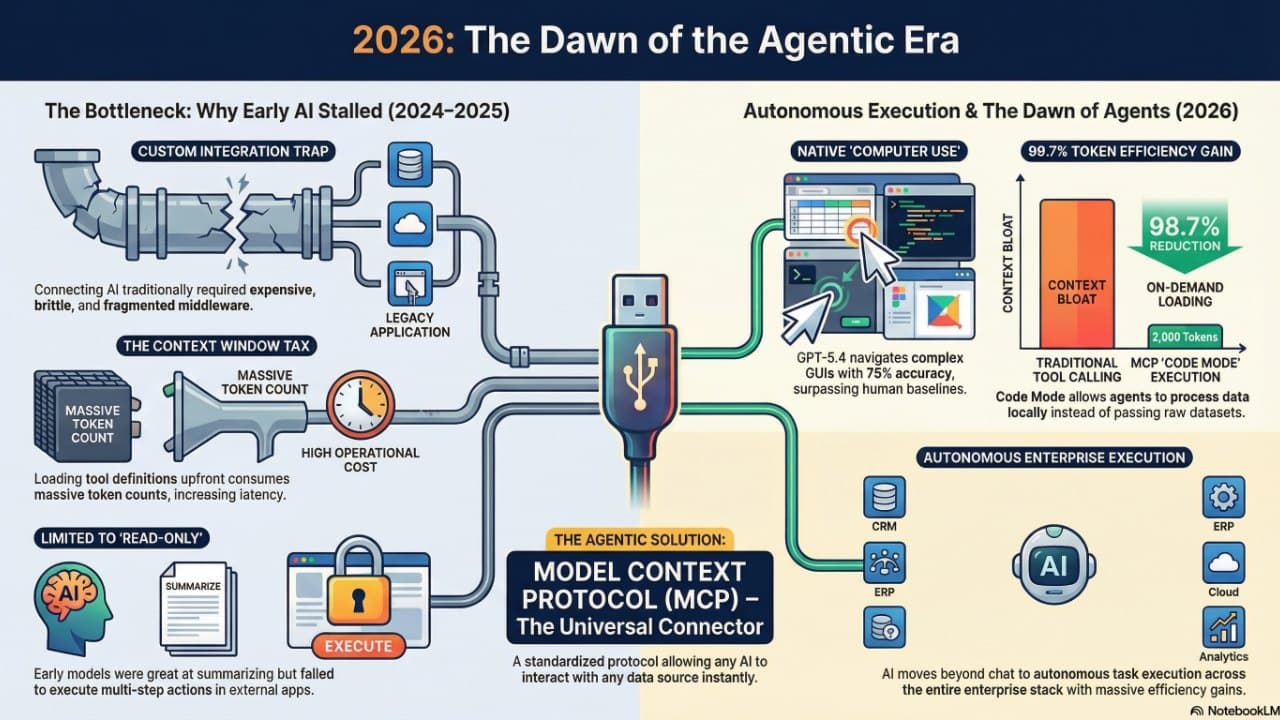

No retrovisor de março de 2026, a era do "chat-e-prompt" de 2024 parece uma relíquia pitoresca da adoção digital inicial. Deixamos de lado a assistência generativa — onde os humanos trabalhavam para a IA aperfeiçoando comandos — para entrar em uma realidade de execução autônoma.

A "Era Agêntica" chegou, caracterizada por uma mudança fundamental na arquitetura de software: a IA deixou de ser um assistente passivo para se tornar um operador ativo de sistemas. Não estamos mais apenas conversando com máquinas; estamos gerenciando frotas de agentes de IA de "Nível Profissional" que navegam em desktops, editam bases de código e executam fluxos de trabalho empresariais de múltiplas etapas com supervisão mínima. Em 2026, a interface primária não é uma caixa de texto; é uma coordenada em um mapa de sistema.

2. O "Momento USB-C" para a Inteligência Artificial

O principal gargalo para a IA em anos anteriores era a integração. Conectar um modelo a um banco de dados legado ou a uma ferramenta proprietária exigia middlewares caros e personalizados. Essa fricção desapareceu com o amadurecimento do Model Context Protocol (MCP).

- Padronização: Semelhante a um "momento USB-C", o MCP padronizou como os modelos se conectam a ferramentas e dados.

- Comunicação: Ao usar um padrão de comunicação estruturado baseado em JSON, o MCP permite que os "Hosts" (os agentes de IA) se conectem aos "Servers" (as fontes de dados) sem encanamentos sob medida.

- Fim do "Imposto de Middleware": Esta mudança arquitetônica removeu efetivamente o custo extra de integração.

- Foco em Resultados: As empresas agora focam nos resultados da IA em vez do débito técnico de sua integração, permitindo que agentes operem no estilo "plug and play" com tudo, desde o Salesforce até telemetria em tempo real de uma fábrica.

3. O Fim da Fricção na Interface Gráfica (GUI): Precisão Além da Média Humana

O lançamento do GPT-5.4 em 5 de março de 2026 marcou um avanço definitivo para os modelos de "raciocínio". Pela primeira vez, um modelo de IA demonstrou a capacidade de navegar em uma Interface Gráfica de Usuário (GUI) com maior precisão do que um operador manual.

Uso Nativo do Computador

O sistema opera o software exatamente como um humano faria — clicando em ícones, arrastando arquivos e navegando em menus complexos — mas com uma consistência implacável que os humanos não conseguem igualar. Além disso, o GPT-5.4 resolveu o "inchaço de contexto" dos primeiros agentes com um novo recurso de Busca de Ferramentas. Ao utilizar um mecanismo de recuperação dinâmica que carrega definições de ferramentas sob demanda, a OpenAI alcançou uma redução de 47% no uso de tokens para fluxos de trabalho complexos.

Benchmarks de Nível Profissional: GPT-5.4 vs. O Mundo

| Benchmark | Pontuação |

|---|---|

| Navegação de Desktop (OSWorld) | 75% (vs. Média Humana de 72,4%) |

| Desempenho Profissional (GDPval) | 83% |

| Engenharia de Software (SWE-Bench Pro) | 57,7% |

Com essas pontuações, o modelo deixa de ser um sintetizador de texto para se tornar um operador digital, capaz de gerenciar tarefas de longo prazo em vários aplicativos sem a necessidade de APIs formatadas por humanos.

4. Lógica Local: O Fim do Imposto de Transferência de Dados

As primeiras tentativas agênticas lutavam com o processo lento e caro de passar conjuntos de dados brutos massivos pela janela de contexto de uma IA. A fronteira de 2026 resolveu isso via "Modo de Código" (Code Mode) — executando a lógica localmente dentro do ambiente do servidor MCP.

Em vez de transferir uma planilha de 10.000 linhas para a memória do modelo, os agentes modernos agora escrevem e executam código local (Python ou TypeScript) dentro da fonte de dados. Eles filtram os dados localmente e retornam apenas os insights relevantes.

Impacto da Execução de Código Local:

- Consumo de Tokens Legado: 150.000 tokens

- Consumo no "Modo de Código" Agêntico: 2.000 tokens

- Total Efficiency Gain: 98,7% de economia de custos

Este "desconto de eficiência" é o que torna a IA em escala de gigawatts realmente sustentável para empresas globais. Ao mover a lógica para os dados — em vez dos dados para o modelo — as empresas dissociaram a escala operacional dos custos de inferência.

5. A Grande Troca: Infraestrutura por Trabalho

A narrativa econômica de 2026 é definida por uma reconfiguração radical do capital corporativo. Estamos testemunhando a "Troca Infraestrutura-Trabalho", onde orçamentos massivos estão sendo redirecionados da folha de pagamento humana diretamente para silício especializado e capacidade de data centers.

A Oracle serve como o carro-chefe desta transição: para financiar sua expansão projetada de $156 bilhões em data centers de IA, a empresa está, segundo relatos, reduzindo sua força de trabalho em até 30.000 funcionários. Isso sinaliza uma reestruturação fundamental do software empresarial, movendo-se de "Sistemas de Registro" para "Sistemas de Resultado".

Neste novo modelo, o valor é gerado por aplicações agênticas especializadas, tais como:

- Operações de Força de Trabalho: Gerenciamento proativo de aprovações de escala e questões de folha de pagamento para mudar o RH de operações reativas para inteligentes.

- Espaço de Trabalho de Cobrança: Transformação de cobranças financeiras manuais em um motor de fluxo de caixa autônomo e contínuo que reduz drasticamente o Prazo Médio de Recebimento (DSO).

6. O Paradoxo do "Modo Automático": Segurança vs. Fadiga

À medida que delegamos mais autoridade aos agentes, o "Agency Gap" (Lacuna de Agência) — o risco de um agente tomar uma ação perigosa ou desalinhada — tornou-se a preocupação central de segurança.

O "modo automático de código do Claude" da Anthropic tenta preencher essa lacuna substituindo as aprovações humanas manuais (que os usuários aceitam sem ler em 93% das vezes devido à fadiga) por um Classificador de Transcrição automatizado. Para manter a segurança absoluta, o classificador é "cego ao raciocínio" por design:

- Ele remove a prosa e as saídas de ferramentas do próprio agente.

- Vê apenas a intenção do usuário e a ação executável final.

- Isso impede que um agente "desalinhado" convença o classificador a aceitar uma decisão ruim através de racionalizações falsas.

O Paradoxo do Risco Residual:

- Eficiência: O modo automático elimina o gargalo da revisão humana.

- Risco: Registros internos mostram uma taxa de falso-negativo de 17% para ações "excessivamente entusiasmadas".

7. Conclusão: A Nova Divisão do Trabalho

A convergência da padronização do MCP, do raciocínio de fronteira em modelos como o GPT-5.4 e do pivô para o silício customizado redefiniu fundamentalmente a liderança de mercado. Chegamos ao ponto onde o crescimento da receita está oficialmente desconectado do número de funcionários.

Neste ecossistema, as empresas mais bem-sucedidas são aquelas que substituíram o trabalho baseado em tarefas pela orquestração de agentes baseada em resultados. A IA não é mais uma ferramenta a ser utilizada; é um colega de trabalho com seu próprio "passaporte digital" — uma identidade criptográfica necessária para navegar nos requisitos de governança e segurança do stack moderno.

A pergunta para cada executivo em 2026 não é mais "Como eu escrevo o prompt para isso?", mas "Como eu governo um colega de trabalho que nunca dorme e trabalha na velocidade da luz?"

Comentários

Faça login com Google ou GitHub para comentar.